Astăzi, algoritmii Facebook par să continue misiunea LifeLog, filtrând conținutul pentru a promova narațiunile oficiale și a controla comportamentul

Pe 4 februarie 2004, DARPA închidea LifeLog, un proiect militar de supraveghere digitală a vieții umane. În aceeași zi, Mark Zuckerberg lansa Facebook.

În România, aceștia au influențat studenții, medicii și profesorii să-l susțină pe Nicușor Dan în 2025, doar ca apoi să se „întoarcă” împotriva lor, amplificând diviziunea socială pentru a justifica măsurile de austeritate ale lui Ilie Bolojan. Acest articol analizează această manipulare, cu exemple din pandemie și criza electorală din 2024-2025, arătând cum algoritmii favorizează narațiunile oficiale, divizează societatea și continuă viziunea LifeLog.

I. De la LifeLog la Facebook

LifeLog, un proiect DARPA din 2003, urmărea să înregistreze digital activitățile, conexiunile și preferințele unei persoane pentru analiza comportamentală. Închis în 2004, scopurile sale – supravegherea și controlul comportamentului – par preluate de Facebook. Spre deosebire de LifeLog, care folosea mandate, Facebook obține date voluntar, prin like-uri și share-uri, folosind algoritmi care promovează narațiunile oficiale și marginalizează opoziția. Dezvăluirile PRISM din 2013, care au arătat că NSA accesează datele Facebook, întăresc această legătură.

II. Cum funcționează algoritmii Facebook și ce „lasă să treacă”?

Algoritmii rețelelor sociale, precum cei ai Facebook, analizează datele utilizatorilor (click-uri, like-uri, share-uri, timp petrecut, chiar și pauzele de scroll) pentru a construi un profil comportamental detaliat. Aceste date alimentează un proces numit filtrare algoritmică, care decide ce conținut „trece” în fluxul utilizatorilor și ce este marginalizat, maximizând „angajamentul” – timpul petrecut pe platformă și interacțiunile care generează profit. Iată cum funcționează și ce prioritizează:

- Mecanisme tehnice: Algoritmii folosesc modele de machine learning, precum rețelele neurale, pentru a clasifica postările pe baza „scorurilor de relevanță”. Aceste scoruri sunt calculate în funcție de:

- Interacțiunile utilizatorului: Like-urile, comentariile și share-urile tale determină ce conținut ți se potrivește. De exemplu, dacă interacționezi cu postări pro-vaccin, algoritmul îți va arăta mai mult conținut similar.

- Emoțiile generate: Postările care stârnesc reacții puternice (furie, teamă, speranță) primesc scoruri mai mari, pentru că te țin lipit de platformă. De exemplu, un titlu precum „Spitalele se prăbușesc!” va fi promovat peste un raport științific sobru.

- Aprobarea oficială: Conținutul aliniat cu narațiunile susținute de guverne, ONG-uri sau parteneri comerciali (ex. campanii de sănătate, mesaje electorale „corecte”) este favorizat prin „boosting” automat sau prin parteneriate. Frances Haugen, fostă angajată Facebook, a dezvăluit că platforma prioritizează conținutul care se aliniază cu interesele autorităților sau advertiserilor.

- Ce „trece”: Algoritmii lasă să treacă postări care:

- Susțin narațiunile oficiale: În pandemie, postările RO Vaccinare sau articolele despre „pericolul antivacciniștilor” erau amplificate, pentru că se aliniau cu campaniile guvernamentale. În alegerile din 2024-2025, postările care susțineau „ingerința rusă” sau pe Nicușor Dan ca „salvator” au dominat fluxurile.

- Generează emoții intense: Mesaje care provoacă frică (ex. „Rușii manipulează alegerile!”) sau speranță (ex. „Nicușor Dan salvează democrația!”) sunt promovate, indiferent de acuratețe.

- Servesc profitul: Postările sponsorizate sau cele care țin utilizatorii pe platformă (ex. clipuri virale, meme-uri) primesc prioritate.

- Ce este marginalizat: Algoritmii reduc vizibilitatea („shadowban”) sau etichetează ca „dezinformare” postările care:

- Contestă narațiunile oficiale: În pandemie, postările antivaccin (ex. ale Dianei Șoșoacă) erau marcate sau aveau reach-ul limitat. În 2024, clipurile pro-Călin Georgescu au fost inițial virale, dar după anularea alegerilor, au fost suprimate în favoarea mesajelor anti-„ruși”.

- Sunt neutre sau complexe: Analizele științifice detaliate sau opiniile moderate, care nu stârnesc emoții, sunt „îngropate” în flux. De exemplu, un studiu despre efectele vaccinurilor avea mai puține șanse să devină viral decât un clip alarmist.

- Contravin intereselor comerciale: Postările care critică advertiserii sau partenerii platformei (ex. companii farmaceutice în pandemie) sunt deprioritate.

- Mecanisme psihologice: Algoritmii exploatează vulnerabilități precum:

- Bucla dopaminei: Like-urile și notificările creează dependență, încurajând utilizatorii să caute validare.

- Bulele de filtrare: Algoritmii creează „ecouri” care întăresc convingerile existente, izolând utilizatorii în grupuri polarizate (ex. pro-vaccin vs. antivaccin).

- Urgența emoțională: Conținutul care stârnește frică sau speranță este amplificat, reducând gândirea critică.

Această filtrare selectivă reflectă obiectivele LifeLog: să monitorizeze comportamentul și să-l modeleze, dar prin consimțământ voluntar, nu prin mandate.

III. Pandemia: Frica și stigmatizarea antivacciniștilor

În pandemia de COVID-19 (2020-2022), algoritmii Facebook au promovat narațiunea oficială a vaccinării, marginalizând vocile antivaccin și polarizând categorii precum profesorii și medicii.

- Mecanismul: Postările RO Vaccinare, ale medicilor pro-vaccin (ex. Raed Arafat, Vasi Rădulescu) și articolele despre „colapsul spitalelor” au fost viralizate, amplificând frica. Vocile antivaccin, precum Diana Șoșoacă sau medici citați pe ActiveNews, erau etichetate „dezinformare” sau copleșite de comentarii ostile, datorită algoritmilor care favorizau narațiunea oficială.

- Impactul asupra profesorilor: Cadrele didactice pro-măsuri sanitare erau promovate ca „responsabile”, dar cele care contestau vaccinurile erau atacate în grupuri de Facebook, amplificate de algoritmi, ca „conspiraționiste”.

- Impactul asupra medicilor: Medicii pro-vaccin dominau fluxurile, în timp ce cei antivaccin erau marginalizați, divizând comunitatea medicală și erodând încrederea publică.

IV. Criza electorală: „Rușii”, Nicușor Dan și intelectualii

Anularea alegerilor prezidențiale din 2024 și alegerea lui Nicușor Dan în 2025 au arătat cum algoritmii promovează narațiunile oficiale, influențând studenții, medicii și profesorii, doar ca apoi să le întoarcă împotriva lor.

- Anularea alegerilor: Călin Georgescu a fost propulsat de clipuri TikTok suspectate de legături cu Rusia, amplificate inițial de algoritmi. După anulare, algoritmii au promovat teoria „rușii manipulează alegerile”, cu postări pe X și Facebook care susțineau narațiunea oficială a autorităților, justificând decizia Curții Constituționale.

- Promovarea lui Nicușor Dan: În campania din 2025, algoritmii au amplificat postări care îl prezentau pe Dan ca „salvator european”. Apelul intelectualilor (Alina Mungiu-Pippidi, Gabriel Liiceanu, Andrei Pleșu), cu peste 800 de semnături, a devenit viral pe X, promovând o „Românie onestă” și criticând „extremismul rusesc”. Aceste mesaje au convins masiv studenții, medicii și profesorii să-l voteze pe Dan, atrași de narațiunea „salvării democrației”.

- Rolul intelectualilor: Algoritmii au favorizat articolele și postările lui Mungiu-Pippidi, Liiceanu și Pleșu, care susțineau narațiunea oficială pro-Dan. Postările lor, cu mesaje emoționale („apărați Europa”), au dominat fluxurile, aliniindu-se cu obiectivele LifeLog de modelare comportamentală.

- Întoarcerea algoritmilor: După alegerea lui Dan, algoritmii s-au „întors” împotriva profesorilor, medicilor și studenților. Postările care îi acuzau de „incompetență” (profesori), „corupție” (medici) sau „lipsă de inițiativă” (studenți) au fost amplificate pe X și TikTok, divizând societatea. De exemplu, clipuri virale despre „profesori leneși” sau „medici care cer șpagă” au pregătit terenul pentru acceptarea măsurilor de austeritate.

V. Măsurile lui Bolojan și categoriile afectate

Măsurile de austeritate ale premierului Ilie Bolojan din 2025 (comasarea claselor, reducerea fondurilor pentru sănătate, creșterea taxelor universitare) au lovit întreaga populație, dar profesorii, medicii și studenții – care au susținut masiv narațiunea pro-Dan – au fost afectați suplimentar, datorită divizării amplificate de algoritmi.

- Profesorii: Creșterea normelor didactice și reducerea burselor amenință mii de posturi. Algoritmii au amplificat postări care blamează profesorii pentru „ineficiență” sau „salarii nemeritate”, aliniindu-se cu narațiunea oficială a reformei.

- Medicii: Reducerile bugetare și excluderea soților/părinților fără venituri din asigurările medicale au afectat accesul la sănătate. Postările care acuzau medicii de „corupție” au fost viralizate, justificând tăierile.

- Studenții: Reducerea burselor și creșterea taxelor universitare au lovit această categorie, atrasă de apelul intelectualilor să voteze Dan. Algoritmii au amplificat mesaje care blamează studenții pentru „lipsă de inițiativă”.

- Divizarea socială: Algoritmii au facilitat divizarea prin promovarea narațiunilor care pun profesorii, medicii și studenții unul împotriva celuilalt (ex. „profesorii vs. părinții”, „medicii vs. pacienții”). Acest climat a făcut austeritatea mai acceptabilă pentru public.

VI. Facebook, moștenitorul LifeLog

Algoritmii Facebook, care au promovat narațiunile oficiale în pandemie (pro-vaccin) și alegeri (pro-Dan, anti-„ruși”), apoi au întors categoriile sociale una împotriva alteia, continuă misiunea LifeLog: supravegherea și controlul comportamental. Dacă LifeLog voia să monitorizeze prin mandate, Facebook o face prin consimțământ voluntar, folosind datele pentru a amplifica ce „convine” autorităților sau platformei. PRISM a arătat că aceste date ajung la NSA, consolidând legătura.

VII. Ce spun platformele?

Meta susține că algoritmii „personalizează” conținutul și respectă GDPR. Totuși, promovarea selectivă a narațiunilor oficiale și lipsa transparenței (algoritmii sunt „cutii negre”) sugerează alinierea cu interese guvernamentale și profitul.

VIII. Ce putem face?

- Conștientizare: Înțelege că algoritmii promovează narațiunile oficiale și divizează societatea.

- Reducerea datelor: Limitează interacțiunile și ajustează setările de confidențialitate.

- Surse independente: Verifică informațiile din surse primare, nu doar rețele sociale.

Concluzie

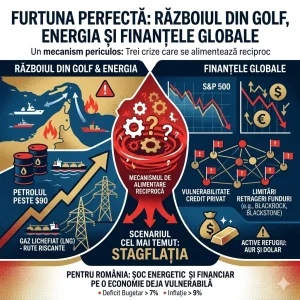

Algoritmii rețelelor sociale, moștenitori ai LifeLog, modelează comportamentul prin promovarea narațiunilor oficiale. În pandemie, au stigmatizat antivacciniștii. În 2024-2025, au convins studenții, medicii și profesorii să-l susțină pe Nicușor Dan, doar ca apoi să amplifice postări care îi blamează, justificând măsurile lui Bolojan. Această divizare, orchestrată de algoritmi, arată că Facebook continuă viziunea LifeLog: controlul prin consimțământ. Ce alegi să faci cu datele tale?